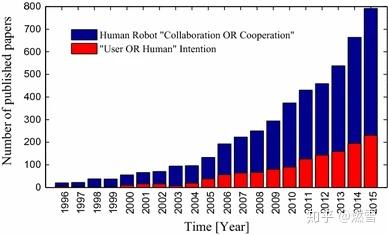

本期為 Springer 旗下 Autonomous Robots 期刊 2018年6月特刊,主題為人機協(xié)作(Human-Robot Collaboration)中的學習。

https://link.springer.com/journal/10514/volumes-and-issues/42-5link.springer.com本期共收錄10篇文章,涵蓋了協(xié)同操縱、醫(yī)療機器人和社交行為等方向。

引言:機器人一度被隔離在安全防護欄之內,但正在逐漸與人類共享使用空間,包括生產線、家里、博物館或者醫(yī)院。在這些使用情況下,人與機器人的協(xié)作(Human-Robot Collaboration, HRC)變得至關重要,給機器人算法帶來了新的挑戰(zhàn)。機器人必須了解人類協(xié)作者的意圖并傳達自己的意圖,預測人類行為并適應其行為,決定何時主導任務或協(xié)助人類操作者。這需要機器人可以執(zhí)行不同的任務,并迅速適應用戶的動作和需求,這種適應性使得學習(Learning)成為協(xié)作機器人的關鍵需求。

Paper 1: Progress and Prospects of the Physical Human–Robot Collaboration

本文主要回顧了人機接口(Human-Robot Interfaces)、控制方法、系統(tǒng)穩(wěn)定性、基準和相關實例的最新進展,并對無縫的人-機器人-環(huán)境交互進行展望。

機器人感知接口:致力于提升機器人感知人類行為的能力,目前涵蓋視覺、力反饋、生物信號、評估人類生理或情緒狀態(tài)、語言命令、多模態(tài)接口等研究方向。

人類感知接口:利用人類發(fā)達的觸覺反饋、視覺反饋(VR)、電子皮膚、紋理信息、機械壓力等手段提高人機交互速度和機器反應時間。

互動方式:給機器人交互過程賦予多種策略,包括阻抗控制框架、高斯混合模型預測意圖、動態(tài)角色互換機制、視覺感知跟蹤人體運動、根據(jù)人類工作者狀態(tài)主動觸發(fā)交互行為、隱馬爾科夫模型在線預測、多模態(tài)交互方式等。

穩(wěn)定性:考慮到即使人和機器人兩個系統(tǒng)獨立穩(wěn)定時,耦合后的人機系統(tǒng)也可能是不穩(wěn)定的,分析人機協(xié)作系統(tǒng)在不同的相互作用情況下的穩(wěn)定性至關重要。此外透明度Transparency(順應操作者意圖)、可讀性(易于被人類理解的運動意圖)、預測能力也是人機協(xié)作中的重要因素。

基準與相關實例:基準部分包括心理評估基準、基準測試應用程序、機器人擬人化、人體工程學等方面。應用部分包括建筑工地微型挖掘機、康復機器人、觸覺指導手杖、工業(yè)協(xié)同裝配、協(xié)作操縱非剛性物體(如疊桌布)等方面。

https://link.springer.com/article/10.1007/s10514-017-9677-2link.springer.comAjoudani, A., Zanchettin, A.M., Ivaldi, S.et al. Progress and prospects of the human–robot collaboration. Auton Robot 42,957–975 (2018).

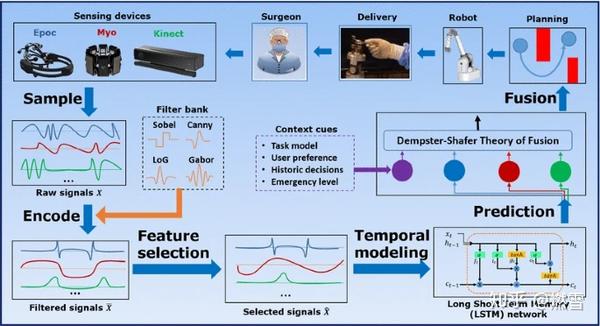

Paper 2: Early prediction for physical human robot collaboration in the operating room

本文研究了手術室中協(xié)作機器人的任務轉換預測(Turn-taking Prediction),即機器人需要了解人類同伴正在進行的動作,預測下一步動作并進行相應操作。這種早期預測能力可以準確預測任務轉換的準確時間,盡早開始運動計劃和執(zhí)行以平滑過渡,這種主動行為可以減少協(xié)作者等待時間,提高任務執(zhí)行效率。

本文提出了一種手術室中使用的護士機器人用以緩解護士人力資源緊張,該機器人可以理解外科醫(yī)生的多模式信息(包括語言型顯式信息和姿態(tài)型隱式信息)并進行預測。測試結果表明,在給出很少的部分輸入時(30%的全部動作),該機器人精度比人類更高;當數(shù)據(jù)量更大時,該機器人精度與人類相當。硬件采用了Myo臂章、Epoc耳機和Kinect運動感知器件用以檢測醫(yī)生的多模態(tài)信號,保留相關特征并用LSTM網(wǎng)絡進行預測,使用Demspter-Shafer方法融合不同預測結果,隨后觸發(fā)運動規(guī)劃算法,拾取正確的器械交給醫(yī)生。

Zhou, T., Wachs, J.P. Early prediction for physical human robot collaboration in the operating room. Auton Robot 42,977–995 (2018).

Paper 3: Skill-based human–robot cooperation in tele-operated path tracking

本文提出了一種基于共享控制的遙操作框架,并且能適應不同操作者的操作能力。使用常規(guī)機器學習方法提取運動與任務相關的特征,并評估操作人員在執(zhí)行遙操作任務多方面的技能水平。評估出的技能水平用于相應地修改機器人的行為,防止對熟練操作者進行不必要的限制。

另外部署了四個輔助方法,三個觸覺輔助用運動學指導來改善任務性能,另外一種輔助方法用來幫助操作人員與主設備進行交互并避免工作空間限制,以上四種分別為Guidance active constraint, Isotropic viscosity, Elastic penetration constraint, and Master workspace helper (MWH).

Enayati, N., Ferrigno, G. & De Momi, E. Skill-based human–robot cooperation in tele-operated path tracking. Auton Robot 42,997–1009 (2018).

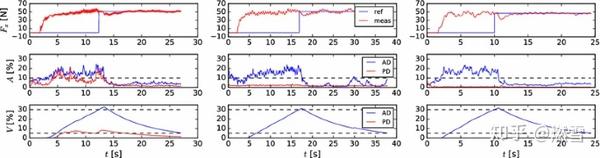

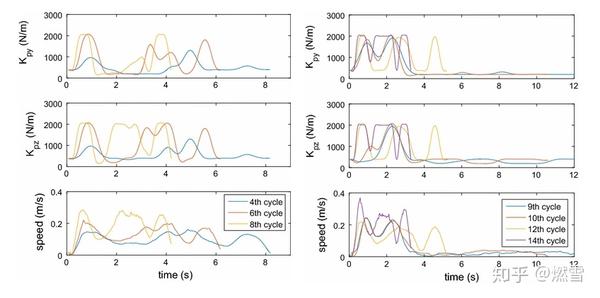

Paper 4: Robot adaptation to human physical fatigue in human–robot co-manipulation

本文提出一種新的人機協(xié)作方法,機器人的行為可以隨著操作者的疲勞程度而在線適應。機器人以跟隨者的身份模仿人類操作,逐漸學習與任務執(zhí)行相關的參數(shù)和軌跡。同時機器會檢測操作者的疲勞程度,當操作者達到預定義的疲勞程度時,機器將接管部分對體能有要求的任務,使得操作者可以恢復體力。

本文通過EMG測得的人類肌肉力量模型來估計協(xié)作者的疲勞程度。在協(xié)作任務執(zhí)行的初始階段,機器人學習物理行為(參考軌跡)。使用動態(tài)運動基元(Dynamical Movement Primitives, DMP)對機器人的運動軌跡進行編碼,這些運動軌跡是通過局部加權回歸(Locally Weighted Regression)在線獲得的。機器人使用自適應頻率振蕩器(Adaptive Frequency Oscillators)估計所需的任務執(zhí)行速度,并控制學習的DMP的相位和頻率。本文在材料切割和表面拋光上進行了實驗驗證。

Peternel, L., Tsagarakis, N., Caldwell, D.et al. Robot adaptation to human physical fatigue in human–robot co-manipulation. Auton Robot 42,1011–1021 (2018).

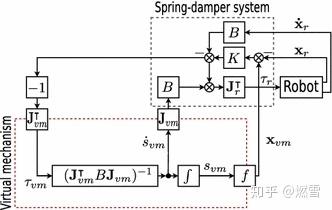

Paper 5: Human robot cooperation with compliance adaptation along the motion trajectory

本文提出了一種直觀的人機交互協(xié)同方法,通過對人類操作者演示行為的初步學習,機器人的行為演變成一項協(xié)作任務,人類協(xié)作者可以在任何階段修改運動軌跡以及執(zhí)行速度。本方法主要特征是:機器人在Frenet-Serret框架下的操作路徑中調整剛度(stiffness),通過將機器人在操作空間中的動力學解耦來得到所需動力學性能,原始速度動態(tài)動作用于底層任務描述(Speed-scaled dynamic motionprimitives are applied for the underlying task representation.)該方法降低了人類操作者動作精度要求,高精度操作可以由機器人進行彌補,人類操作者還可以通過簡單地施加力來改變運動軌跡和速度。

Nemec, B., Likar, N., Gams, A.et al. Human robot cooperation with compliance adaptation along the motion trajectory. Auton Robot 42,1023–1035 (2018).

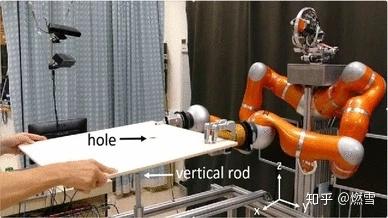

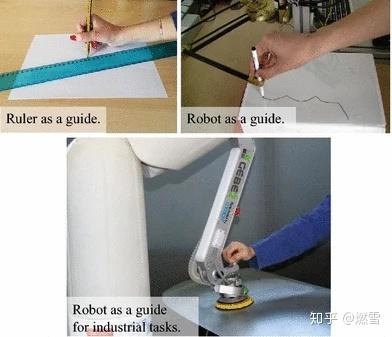

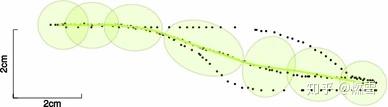

Paper 6: Co-manipulation with a library of virtual guiding fixtures

虛擬引導固定裝置(Virtual guiding fixtures)將機器人的運動限制在與任務相關的軌跡上,并且已成功應用于外科手術和制造過程中。區(qū)別于此前工作考慮的針對單個任務的引導裝置,本文考慮了多個任務的引導裝置庫,并提出以下方法:1)基于機器學習創(chuàng)建和添加引導;2)根據(jù)概率在線選擇相應引導裝置;3)基于增量學習(incremental learning)完善現(xiàn)有引導。實例證明了在工業(yè)任務中,引導裝置庫提供了一個直觀的觸覺界面,用于人機協(xié)作完成任務,并提高了操作者的心理狀態(tài)及減少錯誤。

Raiola, G., Restrepo, S.S., Chevalier, P.et al.Co-manipulation with a library of virtual guiding fixtures.Auton Robot42,1037–1051 (2018).

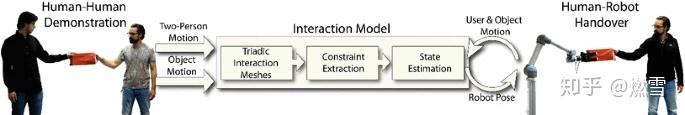

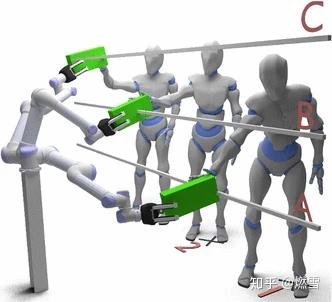

Paper 7: One-shot learning of human–robot handovers with triadic interaction meshes

提出了一種模仿學習方法,使得機器人可以無縫的檢索對象并交給人類使用者。區(qū)別于手工編碼交互參數(shù),本文從兩個人的演示過程中提取相關信息,例如關節(jié)相關性和空間關系。本方法核心為交互模型(Interaction Model),該模型使得機器人能夠將觀察到的演示操作從時間和空間上推廣到新的情況。為此,提出了一種數(shù)據(jù)驅動的方法,用于生成將兩個交互伙伴鏈接到被操作對象的交互網(wǎng)絡。實驗表明人與人之間的任務演示可以訓練出人與機器人的無縫交互。

Vogt, D., Stepputtis, S., Jung, B.et al. One-shot learning of human–robot handovers with triadic interaction meshes. Auton Robot 42,1053–1065 (2018).

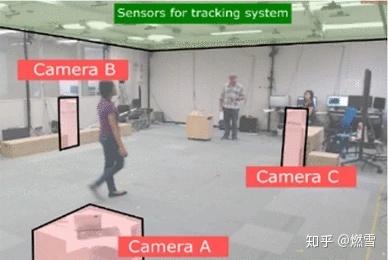

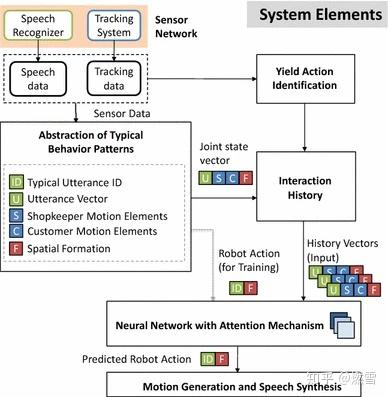

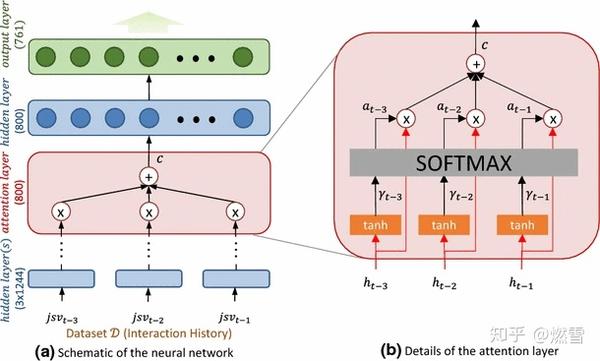

Paper 8: Learning proactive behavior for interactive social robots

本文提出一種從人與人的交互過程中學習機器與人社交行為的方法,選取了照相店主與客戶交互行為作為訓練場景。通過檢測 yield interactions, 合并交互歷史,以及使用注意力機制來了解哪些歷史步驟對于預測機器人行為。該方法可以再現(xiàn)機器人的反應行為(如回答問題),而且可以再現(xiàn)從人與人交互中學習到的前瞻性行為(如提供未經(jīng)請求的信息)。這種框架下的機器人能產生更主動的行為,更有效的與客戶進行互動,擴展以往工作中的數(shù)據(jù)驅動型方法來重現(xiàn)店員行為,提高與真實世界的交互能力。

Liu, P., Glas, D.F., Kanda, T.et al. Learning proactive behavior for interactive social robots. Auton Robot 42,1067–1085 (2018).

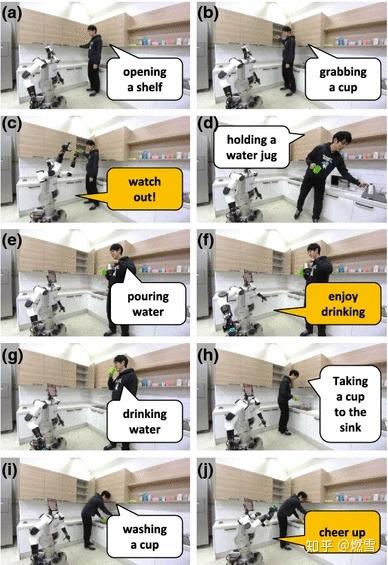

Paper 9: Hierarchical emotional episodic memory for social human robot collaboration

對于社交型人機協(xié)作,機器人需要有效地記住人的經(jīng)歷并管理情感經(jīng)歷和重復性經(jīng)歷。為了實現(xiàn)這些功能,本文提出使用深度自適應共振理論網(wǎng)絡(deep adaptive resonance theory network)的分層情緒情節(jié)記憶。這種記憶不僅可以學習情緒經(jīng)歷,也可以預測未來情緒狀況。本文提供了兩個參數(shù)設置環(huán)節(jié),即延遲合并(delayed consolidation)和即時更新(instant update), 使得情感經(jīng)歷得到更快的增強,保持更長的時間,并且對類似體驗變得更加穩(wěn)定和敏感。在廚房環(huán)境中進行了一項實驗,以演示社交型人機協(xié)作。

Lee, W., Kim, J. Hierarchical emotional episodic memory for social human robot collaboration. Auton Robot 42,1087–1102 (2018).

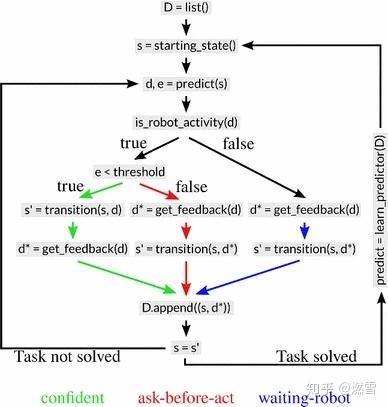

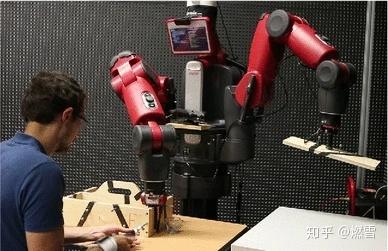

Paper 10: Efficient behavior learning in human–robot collaboration

本文為機器人提供了一種新穎的方法,可以在執(zhí)行人機協(xié)同任務時進行交互式學習,并適應人類的任務執(zhí)行偏好。考慮到不同操作者具有不同的能力、經(jīng)驗和個人偏好,我們試圖使機器人學習任務和用戶的偏好,以提供更有效的協(xié)同執(zhí)行能力,本文主要采用多智能體協(xié)作模型下半馬爾可夫決策過程(Multi-agent collaboration semi-Markov decision),并展示了如何對團隊行為進行建模并了解預期機器人行為。

本文提出了一種交互式學習系統(tǒng),允許機器人學習以協(xié)助操作人員,分為交互式學習、融合訓練和執(zhí)行三個階段,具有以下有點:1)只要對任務有信心,就可以利用當前執(zhí)行數(shù)據(jù)開始自動執(zhí)行操作,使得教學過程更短更輕松,因為機器人在執(zhí)行確定正確的動作時可以自動執(zhí)行操作;2)如果某些部分執(zhí)行錯誤,嘖可以使用新的經(jīng)驗和用戶反饋來修正學習行為,或者如果預期行為發(fā)生變化,則采用新的訓練和反饋。

Munzer, T., Toussaint, M. & Lopes, M. Efficient behavior learning in human–robot collaboration.Auton Robot42,1103–1115 (2018).